Подрядчик разведсообщества США нанял специалиста по кибервойне из ЦРУ

«COSMIC»

Ведущий специалист Лэнгли по кибервойне и внедрению новых технологий, владелец Nightwing: связи с Демпартией США и директором ЦРУ Бернсом, обзор деятельности и ключевых технологии киберкомпании

AI for the Chronically Lazy: Mastering the Art of Doing Nothing with Gemini

The updates to Gemini and Gemma models significantly enhance their technical capabilities and broaden their impact across various industries, driving innovation and efficiency while promoting responsible AI development.

Key Points

Gemini 1.5 Pro and 1.5 Flash Models:

📌Gemini 1.5 Pro: Enhanced for general performance across tasks like translation, coding, reasoning, and more. It now supports a 2 million token context window, multimodal inputs (text, images, audio, video), and improved control over responses for specific use cases.

📌Gemini 1.5 Flash: A smaller, faster model optimized for high-frequency tasks, available with a 1 million token context window.

Gemma Models:

📌Gemma 2: Built for industry-leading performance with a 27B parameter instance, optimized for GPUs or a single TPU host. It includes new architecture for breakthrough performance and efficiency.

📌PaliGemma: A vision-language model optimized for image captioning and visual Q& A tasks.

New API Features:

📌Video Frame Extraction: Allows developers to extract frames from videos for analysis.

📌Parallel Function Calling: Enables returning more than one function call at a time.

📌Context Caching: Reduces the need to resend large files, making long contexts more affordable.

Developer Tools and Integration:

📌Google AI Studio and Vertex AI: Enhanced with new features like context caching and higher rate limits for pay-as-you-go services.

📌Integration with Popular Frameworks: Support for JAX, PyTorch, TensorFlow, and tools like Hugging Face, NVIDIA NeMo, and TensorRT-LLM.

Impact on Industries

Software Development:

📌Enhanced Productivity: Integration of Gemini models in tools like Android Studio, Firebase, and VSCode helps developers build high-quality apps with AI assistance, improving productivity and efficiency.

📌AI-Powered Features: New features like parallel function calling and video frame extraction streamline workflows and optimize AI-powered applications.

Enterprise and Business Applications:

📌AI Integration in Workspace: Gemini models are embedded in Google Workspace apps (Gmail, Docs, Drive, Slides, Sheets), enhancing functionalities like email summarization, Q& A, and smart replies.

📌Custom AI Solutions: Businesses can leverage Gemma models for tailored AI solutions, driving efficiency and innovation across various sectors.

Research and Development:

📌Open-Source Innovation: Gemma’s open-source nature democratizes access to advanced AI technologies, fostering collaboration and rapid advancements in AI research.

📌Responsible AI Development: Tools like the Responsible Generative AI Toolkit ensure safe and reliable AI applications, promoting ethical AI development.

Multimodal Applications:

📌Vision-Language Tasks: PaliGemma’s capabilities in image captioning and visual Q& A open new possibilities for applications in fields like healthcare, education, and media.

📌Multimodal Reasoning: Gemini models' ability to handle text, images, audio, and video inputs enhances their applicability in diverse scenarios, from content creation to data analysis.

Искусственный интеллект для хронически ленивых с Gemini

Обновления моделей Gemini и Gemma значительно расширяют их технические возможности и влияние на различные отрасли, стимулируя инновации и эффективность, а также способствуя ответственному развитию искусственного интеллекта.

Ключевые аспекты

Модели Gemini 1.5 Pro и 1.5 Flash:

📌 Gemini 1.5 Pro: Улучшена общая производительность в таких задачах, как перевод, кодирование, логические рассуждения. Теперь поддерживается контекстное окно с 2 миллионами токенов, мультимодальные входные данные (текст, изображения, аудио, видео) и улучшенный контроль ответов для конкретных случаев использования.

📌 Gemini 1.5 Flash: Компактная и быстрая модель, оптимизированная для высокочастотных задач, доступна в контекстном окне с 1 миллионом токенов.

Модели Gemma:

📌 Gemma 2: Создан для обеспечения лучшей в отрасли производительности благодаря экземпляру с параметрами 27B, оптимизирован для графических процессоров или одного узла TPU. Он включает в себя новую архитектуру, обеспечивающую высокую производительность и эффективность.

📌 PaliGemma: модель языка визуализации, оптимизированная для создания субтитров к изображениям и задач визуального контроля.

Новые возможности API:

📌 Извлечение видеокадров: позволяет разработчикам извлекать кадры из видео для анализа.

📌 Параллельный вызов функций: позволяет выполнять более одного вызова функции одновременно.

📌 Кэширование контекста: Сокращает необходимость повторной отправки больших файлов, делая длинные контексты более доступными.

Инструменты и интеграция для разработчиков:

📌 Google AI Studio и Vertex AI: дополнены новыми функциями, такими как кэширование контекста и более высокие тарифы для платных сервисов.

📌 Интеграция с популярными платформами: поддержка JAX, PyTorch, TensorFlow и таких инструментов, как Hugging Face, NVIDIA NeMo и TensorRT-LLM.

Влияние на отрасли промышленности

Разработка программного обеспечения:

📌 Повышенная производительность: Интеграция моделей Gemini в такие инструменты, как Android Studio, Firebase и VSCode, помогает разработчикам создавать высококачественные приложения с помощью искусственного интеллекта, повышая производительность и результативность.

📌 Возможности на базе искусственного интеллекта: Новые функции, такие как параллельный вызов функций и извлечение видеокадров, упрощают рабочие процессы и оптимизируют приложения на базе искусственного интеллекта.

Корпоративные и бизнес-приложения:

📌 Интеграция искусственного интеллекта в Workspace: модели Gemini встроены в приложения Google Workspace (Gmail, Docs, Drive, Slides, Sheets), что расширяет функциональные возможности, такие как составление резюме по электронной почте, вопросы и ответы, а также интеллектуальные ответы.

📌 Индивидуальные решения в области искусственного интеллекта: Компании могут использовать модели Gemma для создания индивидуальных решений в области искусственного интеллекта, повышающих эффективность и инновации в различных секторах.

Исследования и разработки:

📌 Инновации с открытым исходным кодом: открытый исходный код Gemma демократизирует доступ к передовым технологиям искусственного интеллекта, способствуя сотрудничеству и быстрому прогрессу в исследованиях ИИ.

📌 Ответственная разработка ИИ: Такие инструменты, как Responsible Generative AI Toolkit, обеспечивают безопасность и надежность приложений ИИ, способствуя этичной разработке ИИ.

Мультимодальные приложения:

📌 Задачи на визуальном языке: возможности PaliGemma в области субтитров к изображениям и визуальных вопросов и ответов открывают новые возможности для приложений в таких областях, как здравоохранение, образование и медиа.

📌 Мультимодальное мышление: способность моделей Gemini обрабатывать текст, изображения, аудио- и видеосигналы повышает их применимость в различных сценариях — от создания контента до анализа данных.

Низкофоновый контент через год будет дороже антиквариата. Дегенеративное заражение ноофосферы идет быстрее закона Мура.

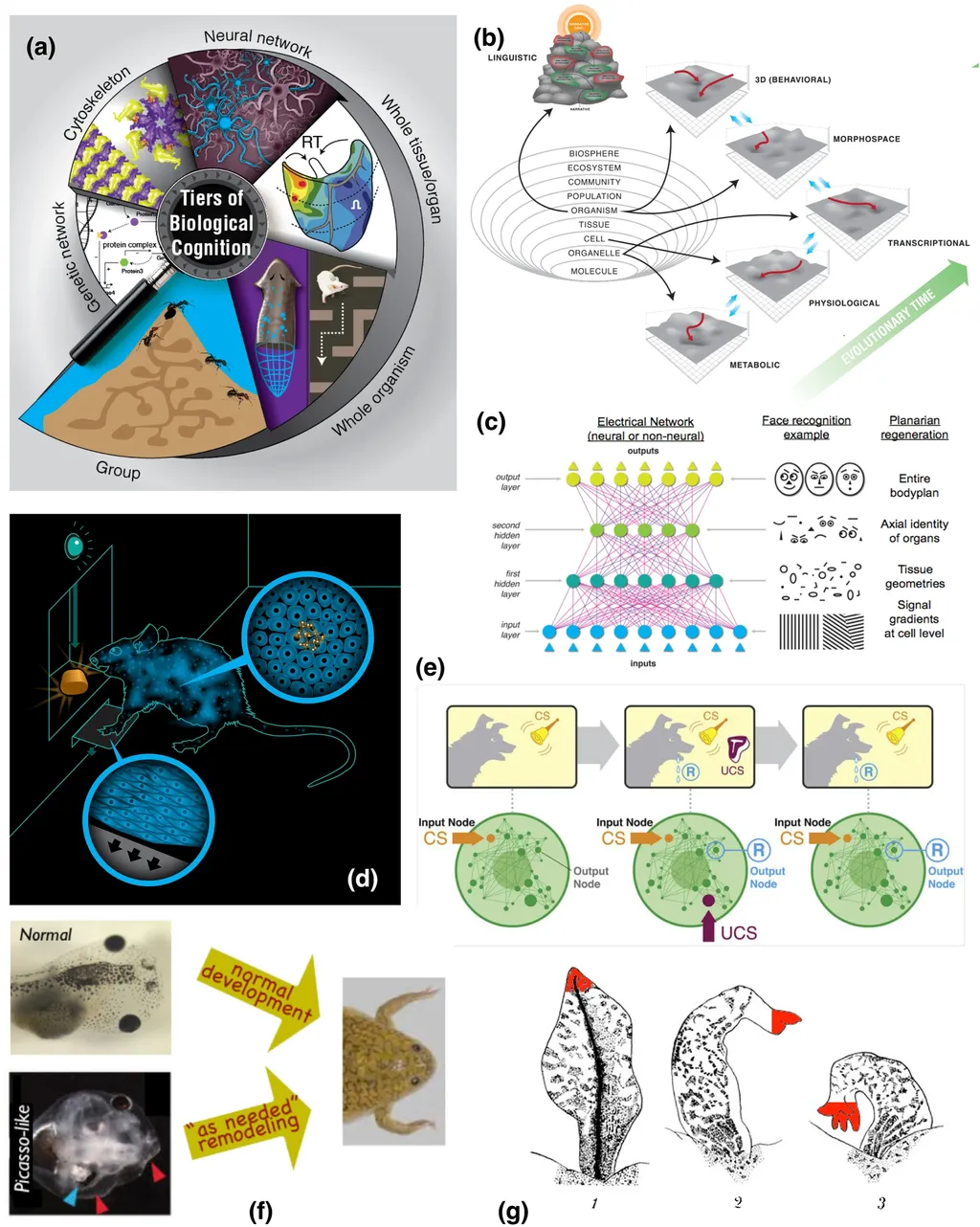

Низкофоновая сталь (довоенная или доатомная сталь) — это любая сталь, произведенная до взрыва первых ядерных бомб в 1940 — 50-х годах.

До первых ядерных испытаний никто и не предполагал, что в результате порождаемого ими относительно невысокого радиоактивного заражения, на Земле возникнет дефицит низкофоновой стали, нужной для изготовления детекторов ионизирующих частиц — счётчик Гейгера, приборы для космоса и так далее.

Но оказалось, что уже после первых ядерных взрывов, чуть ли не единственным источником низкофоновой стали оказался подъем затонувших за последние полвека кораблей. И ничего не оставалось, как начать подъем с морского дна одиночных кораблей и целых эскадр по типу Имперского флота Германии, затопленные в Скапа-Флоу в 1919.

Но и этого способа добычи низкофоновой стали особенно на долго не хватило бы. И ситуацию спасло лишь запрещение атмосферных ядерных испытаний, после чего радиационный фон со временем снизился до уровня, близкого к естественному.

С началом испытаний генеративного ИИ в 2022 г также никто не заморачивался в плане рисков «дегенеративного заражения» продуктами этих испытаний.

· Речь здесь идет о заражении не атмосферы, а ноосферы, что не легче.

· Перспектива загрязнения последней продуктами творчества генеративного ИИ может иметь весьма пагубные и далеко идущие последствия.

Первые результаты заражения спустя 1.5 года после начала испытаний генеративного ИИ поражают свои масштабом. Похоже, что заражено уже все. И никто не предполагал столь высокой степени заражения.

Ибо не принималось в расчет наличие мультипликатора — заражения от уже зараженного контента, о чем вчера поведал миру Ник Сен-Пьер — креативный директор и неофициальный представитель Midjourney.

Данные, опубликованные Ник Сен-Пьером впечатляют:

• Более 13% всех изображений в Adobe Stock созданы с помощью генеративного ИИ.

• Большая часть сгенерированного контента поступает от Dalle и Midjourney.

• Медиа с тегом «фэнтези» на 43% создано ИИ. Другие теги еще выше.

• Это большая часть обучающих данных, которые питают генеративный ИИ Adobe Firefly-генератор изображений на базе ИИ от Adobe.

Скорость затопления инфосети контентом, «зараженным ИИ»-контент произведенный с помощью генеративного ИИ, обученного на контенте, произведенном генеративным ИИ, просто колоссальна.

Получается, что любой контент, произведенный после 2022, включая все интернет-архивы, почти наверняка «заражен» генеративным ИИ, и уровень этого заражения совсем немал. Что и превращает такой генеративный контент, извините за каламбур, в дегенеративный.

Комментируя это, Итан Молик-профессор Уортона, изучающий ИИ, придумал использованную мною выше метафору — низкофоновая сталь.

Продолжая эту метафору, легко представить, что всего через несколько лет «низкофоновый» (догенеративный) контент станет в ноосфере столь же редким и дорогим, как самый изысканный и старинный антиквариат.

Но это еще не все.

В результате роста в обучающих наборах новых моделей генеративного ИИ доли контента, порожденного с помощью предыдущих версий моделей, начнется процесс, названный Россом Андерсоном коллапсом больших языковых моделей (LLM).

Ситуация будет напоминать комедию «Множественность» с Майклом Китоном в главной роли, в которой скромный человек клонирует себя, а затем клонирует клонов, каждое поколение которых ведет к экспоненциальному снижению уровня интеллекта и увеличению глупости клона.

С LLM будет происходить то же самое. Использование для обучения модели контента, сгенерированного моделью, вызывает необратимые дефекты. Хвосты исходного распределения контента исчезают. В течение нескольких поколений текст становится мусором, поскольку распределения Гаусса сходятся и могут даже стать дельта-функциями. Более поздние поколения начнут производить образцы, которые никогда не были бы произведены оригинальной моделью, то есть они будут неправильно воспринимать реальность, основываясь на ошибках, внесенных их предками.

И речь не только про тексты, но и про изображения, видео, музыку. Если вы обучаете музыкальную модель Моцарту, вы можете ожидать, что результат будет немного похож на Моцарта, но без блеска — назовем его «Сальери». И если потом Сальери обучит следующее поколение и так далее, то как будет звучать пятое или шестое поколение?

Вот это и называется «коллапсом модели», в результате которого:

-Интернет все более будет забиваться чушью;

-Люди, которые, наряду с LLM, будут этой чушью информационно напитываться, будут неумолимо глупеть.

Но и это еще не все.

Потом коллапс моделей приведет к тому, что цунами инфомусора окончательно накроет науку.

Разруха, начавшаяся с дегенеративного заражения Интернета, потом имеет все шансы переходить в новые поколения LLM, а потом и в головы новых поколений людей.

И наконец, в добавок ко всему названному, будет нарастать число мутаций языка и подмена когнитивных микроэлементов на помои снов ИИ.

Перспектива вымывания «когнитивных микроэлементов», на смену которым придет синтетический мусор, светит не только разговорным и письменным языкам человечества. Но и языкам наук и изобразительным языкам.

Можно ли все это остановить?

Возможно, да. Если остановить дегенеративное заражение ноофосферы.

Радиоактивное заражение атмосферы человечество смогло остановить, отказавшись от атмосферных испытаний ядерного оружия.

Отказа от генеративного ИИ уже не будет. Этот джин, к счастью или на беду человечества, уже выпущен из бутылки. И слишком заманчивые перспективы для той же науки и здоровья людей этот джин сулит.

Так значит, нужно срочно искать методы обеззараживания ноосферы от дегенеративного заражения, которое уже началось и вовсю идет.

2024 войдет в историю двумя открытиями в области интеллектуальных систем. Сформулированы «закон Ома» и «закон Джоуля — Ленца» для интеллекта людей и машин.

«Промо уровень»

Без $100 ярдов в ИИ теперь делать нечего. В гонке ИИ-лидеров могут выиграть лишь большие батальоны.

Только за последние недели было объявлено, что по $100 ярдов инвестируют в железо для ИИ Microsoft, Intel, SoftBank и MGX (новый инвестфонд в Абу-Даби).

А на этой неделе, наконец, сказал свое слово и Google. Причем было сказано не просто о вступлении в ИИ-гонку ценой в $100 ярдов, а о намерении ее выиграть, собрав еще бОльшие батальоны — инвестировав больше $100 ярдов.

Гендир Google DeepMind Демис Хассабис сказал:

• «… я думаю, что со временем мы инвестируем больше»

• «Alphabet Inc. обладает превосходной вычислительной мощностью по сравнению с конкурентами, включая Microsoft»

• «… у Google было и остается больше всего компьютеров»

Так что в «железе» Google не собирается уступать никому, а в алгоритмах, — тем более.

Что тут же получило подтверждение в опубликованном Google алгоритме «Бесконечного внимания», позволяющего трансформерным LLM на «железе» c ограниченной производительностью и размером памяти эффективно обрабатывать контекст бесконечного размера.

Такое масштабирование может в ближней перспективе дать ИИ возможность стать воистину всезнающим. Т.е. способным анализировать и обобщать контекст просто немеряного размера.

Так и видится кейс, когда на вход модели подадут все накопленные человечеством знания, например, по физике и попросят ее сказать, чего в этих знаниях не хватает.

Взлом LLM моделей

Появление больших языковых моделей (LLM), таких как ChatGPT, открыло новую эру в области искусственного интеллекта, предлагая беспрецедентные возможности в создании текста, похожего на человеческий, на основе обширных наборов данных. Эти модели нашли применение в различных областях, от автоматизации обслуживания клиентов до создания контента. Однако, как и любая мощная технология, LLMS также создает новые проблемы и возможности для киберпреступников, что приводит к усложнению проблем кибербезопасности.

📌Стратегии борьбы с киберпреступностью с помощью LLMS

Киберпреступники изучают различные стратегии использования LLM в своих целях. В целом эти стратегии можно разделить на три категории: покупка, создание или взлом LLM и ряд других.

📌Покупка услуг LLM

Покупка услуг у поставщиков услуг LLM является наиболее простым подходом. Это предполагает использование общедоступных LLM-программ или программ, предлагаемых сторонними поставщиками, для различных вредоносных действий. Простота доступа к этим моделям делает их привлекательными для целого ряда киберпреступлений, от рассылки фишинговых электронных писем до масштабного создания поддельного контента.

📌Создание пользовательских LLM

Некоторые могут предпочесть разработку собственных LLM, адаптированных для выполнения конкретных вредоносных задач. Такой подход требует значительных ресурсов, включая опыт в области машинного обучения и доступ к большим наборам данных для обучения моделей. Специально разработанные LLM могут быть разработаны для обхода мер безопасности и проведения целенаправленных атак, что делает их мощным инструментом в арсенале изощренных киберпреступных групп.

📌Взлом существующих LLM

Ещё одной стратегией является использование уязвимостей в существующих LLM для манипулирования их выводами или получения несанкционированного доступа к их функциональным возможностям. Это может включать в себя такие методы, как быстрое внедрение, когда тщательно продуманные входные данные заставляют LLM генерировать вредоносный контент или раскрывать конфиденциальную информацию. Так называемый джейлбрейк LLM для устранения встроенных ограничений безопасности также является проблемой, поскольку это может привести к созданию некорректного, вводящего в заблуждение или предвзятого контента.

📌Автоматический джейлбрейк LLM

Инновационный подход заключается в использовании одного LLM для нарушения мер безопасности другого. Этот метод предполагает сценарий будущего, напоминающий повествования о киберпанках, где сражения между системами искусственного интеллекта, каждая из которых пытается перехитрить другую, становятся обычным аспектом усилий по обеспечению кибербезопасности. Эта концепция аналогична генеративным состязательным сетям (GAN), где одновременно обучаются две модели: одна для генерации данных (генератор), а другая для оценки их достоверности (дискриминатор). Эта динамика создает непрерывный цикл совершенствования обеих моделей, принцип, который может быть применен к LLM как для наступательных, так и для оборонительных целей кибербезопасности.

📌Битва ботов

Задача систем искусственного интеллекта — поддерживать безопасность цифровой инфраструктуры, в то время как их коллеги пытаются проникнуть в нее. Этот сценарий не является полностью вымышленным; он отражает современную практику в области кибербезопасности, когда автоматизированные системы все чаще используются для обнаружения угроз и реагирования на них. Развитие LLM может ускорить эту тенденцию, что приведет к появлению более сложных и автономных форм киберзащиты и кибератак.

📌Последствия и ответные меры в области кибербезопасности

Использование LLMS киберпреступниками создает серьезные проблемы в области кибербезопасности. Эти модели могут автоматизировать и расширить масштабы традиционных киберпреступлений, делая их более эффективными и труднообнаруживаемыми. Например, LLM могут генерировать весьма убедительные фишинговые электронные письма или атаки с использованием социальной инженерии, что повышает вероятность успешных взломов.

Идея использования состязательных LLM в сфере кибербезопасности имеет несколько последствий. Во-первых, это может повысить эффективность мер безопасности за счет постоянного совершенствования их с учетом потенциальных уязвимостей. Во-вторых, это поднимает вопросы об этических и практических аспектах использования ИИ в таких двойных ролях, особенно учитывая возможность непредвиденных последствий или эскалации киберконфликтов.

📌Защитные меры

Для противодействия угрозам, связанным с вредоносным использованием LLM, специалисты по кибербезопасности разрабатывают ряд защитных мер. К ним относятся улучшение обнаружения контента, созданного искусственным интеллектом, защита LLM от несанкционированного доступа и повышение надежности моделей от несанкционированного использования.

📌Этические и юридические соображения

Потенциальное неправомерное использование LLM также вызывает этические и юридические вопросы. Растет спрос на нормативные акты, регулирующие разработку и использование LLM, для предотвращения их использования киберпреступниками. Кроме того, необходимы этические принципы, гарантирующие, что преимущества LLMS будут реализованы без ущерба для безопасности или конфиденциальности.

📌Перспективы на будущее

По мере дальнейшего развития LLM будут усложняться как возможности, которые они предоставляют, так и угрозы, которые они представляют. Постоянные исследования и сотрудничество между разработчиками искусственного интеллекта, экспертами в области кибербезопасности и политиками будут иметь решающее значение для решения стоящих перед ними задач. Понимая стратегии, которые киберпреступники используют для взлома LLM, и разрабатывая эффективные меры противодействия, сообщество специалистов по кибербезопасности может помочь защитить цифровой ландшафт от возникающих угроз.